Anthropic heeft de Amerikaanse overheid aangeklaagd nadat het Pentagon het bedrijf een “supply chain risk” heeft genoemd. Deze stap kan bepalen hoe aanbieders van kunstmatige intelligentie samenwerken met het leger. De rechtszaak daagt deze beslissing uit en roept vragen op over hoe defensiecontracten AI-systemen inkopen.

Markten kijken nu of het conflict ook andere bedrijven zal raken die verbonden zijn met militaire AI-infrastructuur, zoals softwarebedrijven als Palantir Technologies en defensiebedrijven zoals Lockheed Martin.

Pentagon-label leidt tot juridisch geschil

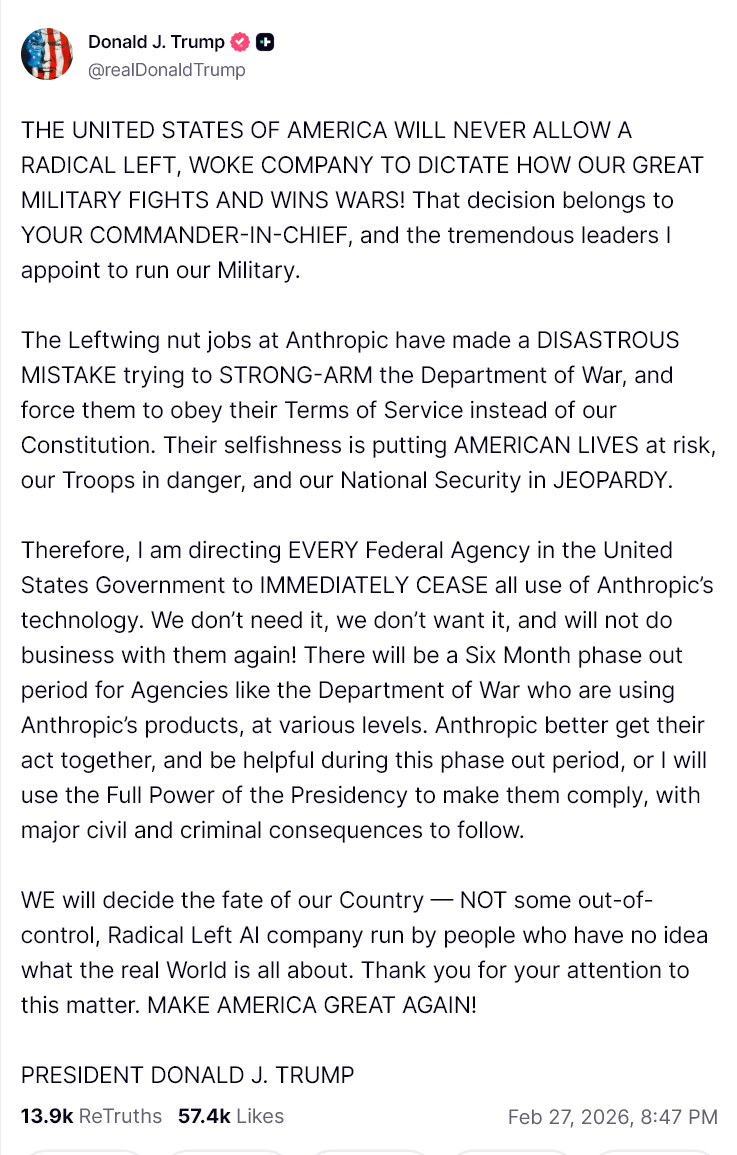

Het geschil begon eerder deze maand toen het Amerikaanse ministerie van Defensie Anthropic officieel tot supply chain risk verklaarde.

Door deze aanwijzing mogen defensiebedrijven in bepaalde militaire programma’s geen AI-systemen van Anthropic gebruiken.

Volgens het Pentagon is deze maatregel nodig om de nationale veiligheid te beschermen en ervoor te zorgen dat AI-tools voor defensiesystemen aan strikte supply-chain-standaarden voldoen.

Door deze beslissing werden meteen bedrijven geraakt die commerciële AI-modellen integreren in militaire software en analysetools.

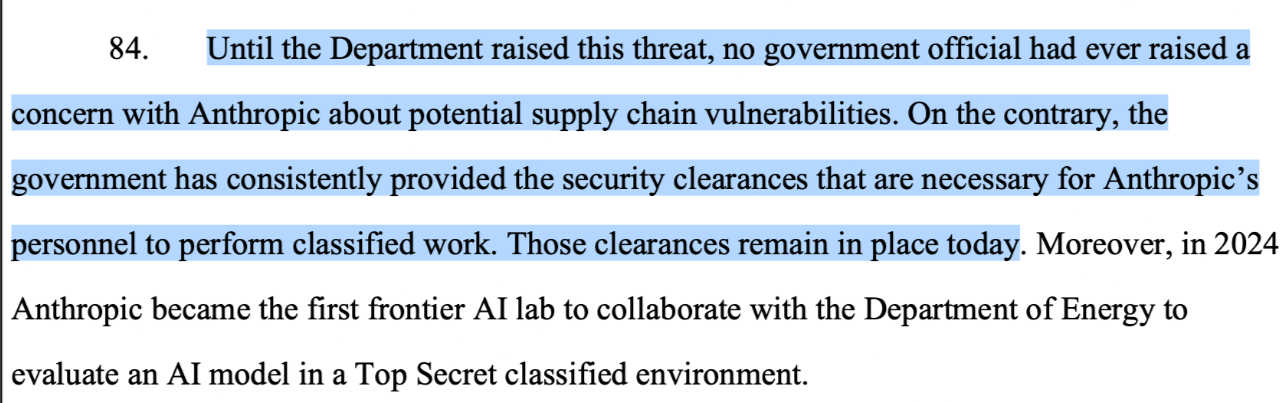

Anthropic is het daar fel mee oneens. Het bedrijf vindt dat de aanwijzing niet transparant is en vreest dat hierdoor een belangrijke AI-aanbieder oneerlijk van overheidsopdrachten wordt uitgesloten.

Maandag diende Anthropic een rechtszaak in tegen de beslissing van de overheid.

Volgens rechtbankstukken stelt het bedrijf dat het Pentagon zonder duidelijk bewijs heeft gehandeld en dat het stempel het moeilijker maakt om mee te dingen naar federale contracten.

De rechtszaak vraagt de rechter om de aanwijzing te blokkeren en de overheid te laten uitleggen wat de nationale veiligheidsredenen zijn voor deze beslissing.

Risico’s voor Amerikaanse defensietechnologiepartners

Deze juridische strijd kan zorgen voor onzekerheid bij bedrijven die afhankelijk zijn van externe AI-modellen in defensiesoftware.

Een van de belangrijkste namen is Palantir Technologies, dat analyseplatforms bouwt die door het Amerikaanse leger en inlichtingendiensten worden gebruikt.

Als de modellen van Anthropic verboden worden in defensieprogramma’s, zullen Palantir en soortgelijke bedrijven waarschijnlijk overstappen op andere AI-aanbieders.

Zo’n overstap kan implementatie vertragen en technische aanpassingen vragen. Toch denken de meeste analisten dat softwarebedrijven de modellen gewoon vervangen zodat ze hun overheidscontracten behouden.

Voor grote defensiebedrijven is het risico kleiner.

Lockheed Martin, het grootste defensiebedrijf van de VS, zegt niet afhankelijk te zijn van één AI-aanbieder. Volgens het bedrijf zal de beslissing van het Pentagon waarschijnlijk nauwelijks invloed hebben op hun projecten.

Dit past in een bredere trend binnen de defensietechnologie: grote bedrijven werken meestal met meerdere leveranciers om niet afhankelijk te worden van één softwareleverancier.

Kans voor concurrerende AI-aanbieders

Hoewel de rechtszaak voor onzekerheid zorgt bij Anthropic, kunnen concurrerende AI-bedrijven er juist van profiteren.

Als het Pentagon vasthoudt aan de beperkingen, kunnen defensiebedrijven andere modellen gaan gebruiken van aanbieders zoals OpenAI of cloud-platforms die gekoppeld zijn aan Microsoft en Amazon.

Deze bedrijven leveren nu al infrastructuur en AI-diensten aan overheidsinstellingen. Een wijziging in het inkoopbeleid kan hun rol in militaire AI-systemen vergroten.

Maar uiteindelijk hangt alles nu af van de rechtbank. Als Anthropic wint, moet het Pentagon mogelijk de supply-chain-aanduiding aanpassen of beperken.

Voor investeerders en defensieaannemers laat het conflict een groter probleem zien.

Nu kunstmatige intelligentie steeds belangrijker wordt voor militaire systemen, kan het vermogen van de overheid om AI-leveranciers goed te keuren of te weigeren zowel de technologiesector als de toeleveringsketens van de defensie-industrie beïnvloeden.