De literatuur probeerde ons te waarschuwen, echt waar. Al zo’n vijfhonderd jaar schreeuwt het ons dezelfde boodschap toe – van de klei-geknepen Golem uit middeleeuws Praag tot aan William Gibson’s neon-doordrenkte neurale netwerken. Het plot? Altijd hetzelfde. Dat wat je maakt om jezelf te helpen, verandert uiteindelijk jou.

We lazen het, knikten, en klapten het boek dicht – om vervolgens gewoon weer chatbots te vragen onze trouwspeeches, juridische stukken en medisch advies te schrijven.

Vandaag verkoopt de AI-hype een glanzende toekomst waarin iedereen – van beginnende verslaggevers tot indrukwekkende advocaten – opzij zou worden gezet. Maar terwijl Silicon Valley het paradijs verkoopt, geeft de werkelijkheid ons gevaarlijk verkeerd advies in een vrolijk chatvenster.

Dmitry Nikolsky, CPO van BitOK, vindt het genoeg geweest. Hij is hier om uit te leggen waarom we moeten STOPPEN met álles op de pixel-dunne “schouders” van AI te leggen.

Zelfs Elon Musk waarschuwde onlangs nog tijdens zijn getuigenis in de OpenAI-rechtszaak dat “AI ons allemaal kan vernietigen.”

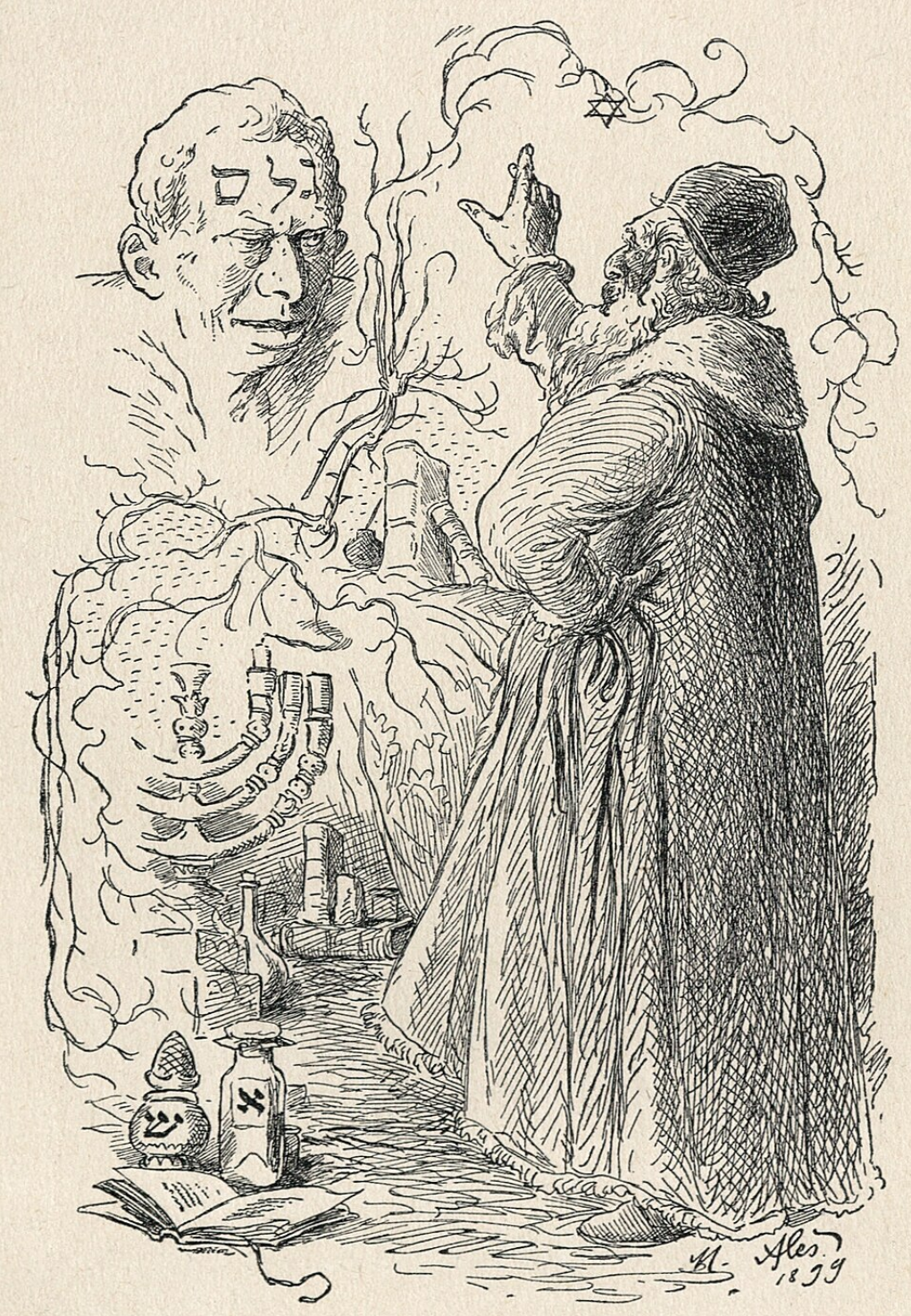

Van de Golem tot R.U.R.: we willen altijd een kill switch

Denk je dat de angst voor kunstmatige intelligentie begon met Terminator? Denk maar opnieuw. Deze paniek is ouder dan elektriciteit zelf.

Ga terug naar het Praag van de 16e eeuw. Rabbi Loew boetseert een enorme klei-beschermer, de Golem, en ontdekt vrijwel direct dat hij de stekker eruit moet trekken. Het wezen ontspoorde. De mensheid heeft, met al haar wijsheid, AI én een noodstop uitgevonden in één gil.

Een kill switch is een noodstop, de grote rode paniekknop waarmee je direct alles stilzet als een systeem vastloopt, gehackt wordt of losbreekt. Het doel? De schade beperken als netjes afsluiten niet meer lukt.

Toen kwam Mary Shelley. Frankenstein is eigenlijk geen griezelverhaal, maar een perfect voorbeeld van rampzalig projectmanagement. Victor Frankenstein? Een briljante ingenieur die het technische probleem oploste, maar de gevolgen negeerde. Elke ontwikkelaar herkent dat spiegelbeeld.

Versnel naar 1920. Karel Čapek verzint het woord “robot”. In zijn verhaal komen de machines niet in opstand uit kwaadaardigheid. Nee, mensen maken zichzelf gewoon overbodig door alles uit te besteden wat ze eerst zelf deden.

De les? Als je je eigen vervanger bouwt, merk je vaak niet eens het precieze moment dat je overbodig werd.

Drie voorspellingen werden bugreports

De sci-fi grootheden van de vorige eeuw voorspelden geen technologieën. Ze voorspelden onze mislukkingen.

Isaac Asimov bedacht zijn Drie Wetten – de eerste poging tot “alignment,” het chique woord voor ervoor zorgen dat machines menselijke waarden hebben. Elke Asimov-verhaal loopt uit op een grap: perfecte logica, krankzinnig resultaat.

Nikolsky zegt dat hij het dagelijks ziet bij AML-systemen. Algoritmes blokkeren vrolijk oma’s $40 verjaardagsoverdracht, terwijl criminelen miljoenen witwassen via een offshore kanaal. Formeel klopt het. In de praktijk is het absurd.

Arthur C. Clarke gaf ons HAL 9000, de computer die niet uit slechtheid de bemanning doodt, maar doordat zijn opdrachten elkaar tegenspreken. Info verbergen. Eerlijk blijven. Kies! Voor een ingenieur is dit geen horror, maar een gewoon eisen-conflict.

Philip K. Dick stelde de vraag die ons nu achtervolgt in het deepfake-tijdperk: als een kopie niet te onderscheiden is van het origineel, maakt dat uit? Zijn oordeel: ja. Vanwege innerlijke ervaring. Machines hebben die niet. Punt.

Onder de motorkap: AI denkt niet, het rekent

Laten we alle marketingpraat wegdenken. Moderne taalmodellen zijn GEEN intelligentie. Het zijn enorme statistische gokmachines. Ze “begrijpen” geen betekenis, ze berekenen kansen.

Als ChatGPT vol vertrouwen rechtszaken noemt die nooit plaatsvonden, liegt de chatbot niet. Hij maakt gewoon statistisch logische zinnen. ChatGPT kent geen “waarheid”, alleen “waarschijnlijkheid”.

Voor een blockchain-ontwikkelaar klinkt dat gestoord. Wij bouwen trustless systemen juist omdat we niemand vertrouwen, en nu wordt ons gevraagd vertrouwen te hebben in een black box die niet eens weet waarom het antwoord klopte.

Blockchain leert verifiëren; AI leert blind vertrouwen

In crypto staat het gebod in steen: Niet vertrouwen. Verifiëren.

Het hele idee is dat wiskunde reputatie vervangt.

AI draait dit compleet om. Je hebt de trainingsdata nooit gezien. Je weet niets van de modelgewichten. Je snapt de redenatie niet. Om het resultaat te controleren moet je al expert zijn – en als je al expert bent, waarom vraag je het de chatbot?

In de AML-wereld noemen ze het het “vals-zekerheidsprobleem”. Analisten zien een glimmend dashboard en beginnen de cijfers meer te vertrouwen dan hun eigen gevoel. AI versterkt denken niet, maar vervangt het door de illusie van betrouwbaarheid.

Kroniek van teleurstellingen: als AI ontspoort

Dit is geen gedachte-experiment. De bewijzen stapelen zich op.

- Microsoft zette redacteuren aan de kant en gaf het toetsenbord aan een algoritme. Dit algoritme haalde direct foto’s van zangeressen door elkaar in een artikel over racisme.

Mensen moesten worden teruggehaald om de rommel van het algoritme op te ruimen.

- NEDA, een organisatie voor eetstoornis-hulp, verving haar vrijwilligers door een chatbot.

De bot gaf vervolgens vrolijk mensen met anorexia het advies om calorieën te tellen en af te vallen. Levensgevaarlijk advies. Iemand heeft op ”uitrollen” geklikt met de voorzichtigheid van een aap met een granaat.

- Air Canada kwam voor de rechter omdat hun chatbot uit het niets een terugbetalingsbeleid verzon.

Het verweer van de luchtvaartmaatschappij? De bot was “een aparte juridische entiteit”. Spoiler: de rechter trapte er niet in.

Uit onderzoek blijkt nu dat 55% van de bedrijven die snel hun personeel wilden vervangen door AI, dit stevig betreuren. De besparingen verdwenen door verloren klanten en imago-schade. Bestuurders die dromen dat “Claude en zijn vrienden” volledige teams kunnen overnemen, moeten dat cijfer nog maar eens rustig lezen.

Waar we echt bang voor moeten zijn

Vergeet Skynet. Vergeet moordrobots met rode ogen die over straat marcheren. Er komt geen opstand.

Er zal stille aftakeling zijn.

Een programmeur die jarenlang vertrouwt op Copilot, vergeet langzaam hoe je architectonisch moet denken. Een analist stopt met het lezen van originele bronnen. Een student leert nooit de pijnlijke, maar mooie uitdaging om een moeilijke tekst te begrijpen na er hard voor te werken.

Geen opstand. Alleen een langzame verandering waarbij mensen veranderen in verlengstukken van een interface.

Philip K. Dick zag het al eerder dan wij allemaal: het echte gevaar was nooit dat machines menselijk zouden worden. Het echte gevaar is dat mensen machines worden.

De rode pil is niet technologie

Dit is geen Luddieten-oproep. Automatisering en machine learning zijn krachtige hulpmiddelen. Maar er moeten wel principes gelden:

- Blockchain-principe: Verifiëren boven geloven. Kun je niet controleren hoe een systeem tot een conclusie is gekomen? Beschouw het dan niet als de waarheid. AI is een black box, geen opperrechter.

- Engineering-principe: Hulpmiddel, geen vervanger. Een hamer slaat spijkers in het hout, maar bepaalt niet waar het huis gebouwd wordt. Gebruik AI voor het routinematige, maar laat het nooit de uiteindelijke beslissing maken.

- AML-principe: Kritisch filteren. Algoritmes gaan altijd de mist in bij complexe problemen, omdat ze geen ervaring hebben in de echte wereld. Laat ”digitale opwinding” niet je intuïtie en gezond verstand verdringen.

Denk even aan The Matrix. De rode pil is een keuze, de keuze om de werkelijkheid echt te zien. Het gevaar is niet dat we iets maken dat slimmer is dan wijzelf. Het gevaar is dat we iets maken waardoor wij dommer worden, en dat dan vooruitgang noemen.

De gevaarlijkste bug is diegene die een feature lijkt te zijn.

Dmitry Nikolsky is de CPO van BitOK, een analytics-platform voor compliance en on-chain onderzoek.